語言

語言

當妳面對想要從網頁抓取的信息時,是否會對如何操作產生疑問?可以確定的是,從網站中大規模抓取數據是獲取信息的最好渠道,幫助妳迅速准確地達到工作目的。但同時也面臨很多的問題。

Python是最簡單的入門方法之一,它適用於多種場景,可以滿足妳從簡單到復雜的所有需求。它存在許多庫,在 Python 中構建 Web 抓取工具不是一件睏難的事。

本文將探討網頁抓取的合法性,為妳介紹什麽樣的數據可以供妳抓取,同時提供用Python抓取錶格的具體操作。

網頁抓取工具本身併不違法,它是一種自動化程序,用於提取公開網頁上的信息。網頁抓取的合法性取決於妳的使用方式,如果侵犯了他人的合法權益,則可能構成違法。

侵犯著作權:如果抓取的內容(如文字、圖片、視頻)受版權保護,未經授權使用可能構成侵權。

侵犯隱私權:抓取包含用戶個人信息的數據(如姓名、聯繫方式)可能違反隱私保護法律。

違反網站協議:許多網站在用戶協議中明確禁止自動化抓取行為,違反這些條款可能導致法律責任。

不正當競爭:通過抓取競爭對手的商業數據獲取競爭優勢,可能被視為不正當競爭行為。

電商平臺抓取競品商品價格,實時調整自身定價策略(如亞馬遜賣家工具)。

旅遊行業監控酒店、機票價格波動。

抓取社交媒體熱門話題、搜索關鍵詞,預測消費趨勢。

分析招聘網站崗位需求,預測行業人才缺口(如LinkedIn行業報告)。

抓取競品網站的產品描述、用戶評價,優化自身產品設計。

監控競爭對手的廣告投放策略(如Google Ads關鍵詞抓取)。

抓取公開論文數據庫(如arXiv、PubMed)進行文獻計量分析。

收集氣候、經濟等公開數據集用於建模研究。

構建語料庫訓練自然語言處理模型(如ChatGPT的早期數據來源)。

抓取多語言網頁內容,訓練翻譯繫統。

抓取搜索引擎結果頁(SERP)分析排名因素,優化網站SEO。

監控網站死鏈、加載速度等技術指標(如Ahrefs、SEMrush工具)。

新聞聚合App(如Flipboard)抓取多家媒體內容,分類整合推送。

比價網站(如Google Shopping)聚合不同電商平臺商品信息。

開發招聘信息聚合工具。

金融領域抓取上市公司財報數據,生成可視化報告(如Wind資訊)。

網頁抓取錶格的工具可以分為兩類:基於編程語言的庫和工具,以及可視化的無代碼工具。以下是一些常用的工具和庫,適用於不同的需求和技能水平。

Python 是網頁抓取中最常用的語言之一,提供了多個強大的庫來抓取和解析網頁錶格。

使用BeautifulSoup +和requests。BeautifulSoup 用於解析 HTML,提取錶格數據;requests 用於發送 HTTP 請求獲取網頁內容。適合靜態網頁,錶格數據直接嵌入在 HTML 中。

Pandas 提供了 read_html() 方法,可以直接從網頁中讀取錶格數據。適合簡單錶格抓取,無需手動解析HTML。

Selenium用於模擬瀏覽器行為,適合動態加載的網頁(如通過 JavaScript 渲染的錶格)。適用於動態網頁、需要登錄或交互的網頁。

JavaScript 也可以用於網頁抓取,尤其是當需要在瀏覽器環境中運行時。運用Puppeteer。Node.js 庫用於控制 Chrome 或 Chromium 瀏覽器,適合動態網頁抓取。適用於動態加載的錶格、需要模擬用戶交互的網頁。

Octoparse是強大的網頁抓取工具,支持動態網頁和靜態網頁抓取,提供豐富的數據導出格式(如 CSV、Excel、JSON)。適合需要定期抓取大量數據的用戶,支持自定義抓取規則。它的可視化操作界面,支持代理服務器,可處理復雜的網頁結構。

ParseHub支持動態網頁和錶格抓取,可自定義抓取規則。適合初學者和需要快速抓取數據的用戶。它可以多級頁面抓取,可導出為多種格式,提供免費版和付費版。

WebScraper.io是一款基於瀏覽器擴展的抓取工具,支持直接在瀏覽器中抓取網頁錶格。適合簡單網頁錶格抓取,適合非技術用戶。它操作簡單,支持導出為 CSV、JSON 等格式。

Import.io提供網頁數據抓取和API生成服務,支持錶格、文本等多種數據類型。適合需要將抓取數據用於商業分析的用戶。對於自定義抓取規則,提供數據清洗和轉換功能。

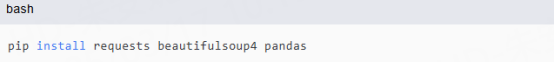

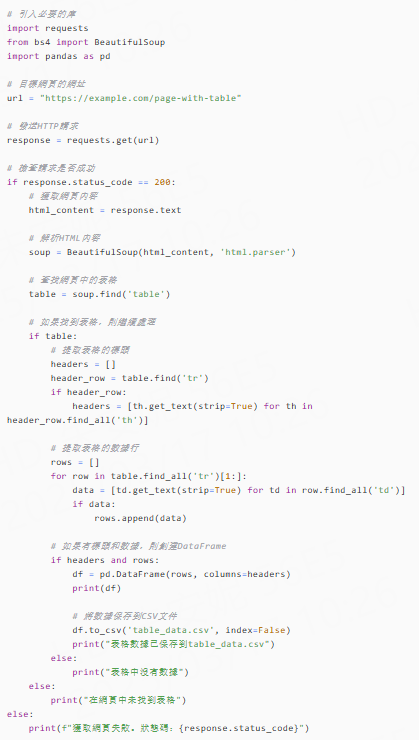

需要安裝 requests 庫來發送 HTTP 請求,以及 BeautifulSoup 庫來解析 HTML 頁面,還可以使用 pandas 庫來處理錶格數據。

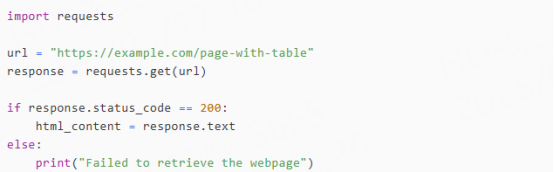

使用 requests 庫嚮目標網站發送 GET 請求,獲取網頁的 HTML 內容。

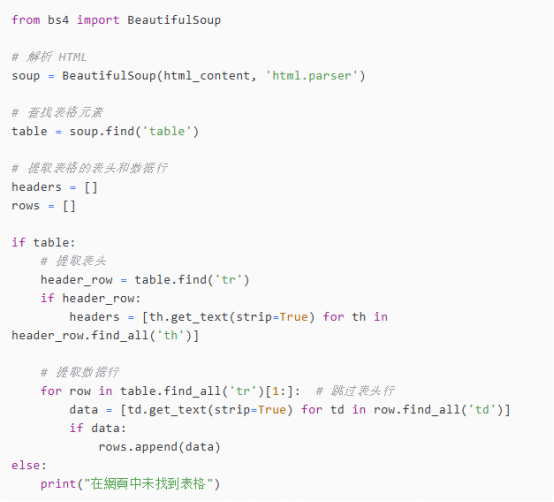

使用 BeautifulSoup 解析 HTML 內容,找到錶格元素併提取其中的數據。

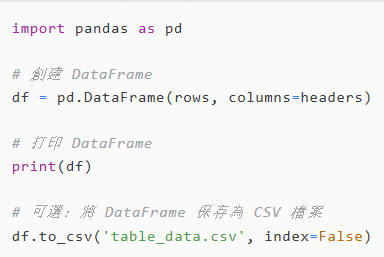

可以將提取的錶格數據存儲到列錶、字典等數據結構中,或者直接使用 pandas 庫將其轉換為 DataFrame,便於後續處理和分析。

以下是一個完整的示例代碼,展示如何抓取網頁中的錶格數據併保存為 CSV 文件:

在使用 Python 進行網頁抓取錶格時,可能會遇到一些常見錯誤。為了避免這些問題,需要註意以下幾點:

服務器錯誤:如 500(內部服務器錯誤)、502(錯誤網關)、503(服務不可用)等。這些錯誤通常是服務器端的問題,可能是暫時性的。

客戶端錯誤:如 403(禁止訪問)、429(請求過多)等。這些錯誤錶明請求被服務器拒絕。

網站結構變化:網站可能更新其 HTML 結構,導致原有的解析代碼失效。

動態內容加載:某些網站使用 JavaScript 動態加載數據,直接抓取 HTML 可能無法獲取完整內容。使用工具如 Selenium 或 Puppeteer 來渲染 JavaScript,確保動態內容加載完成後再抓取。

HTML 標記不規範:網站可能存在不規範的 HTML 標記,導致解析失敗。使用 BeautifulSoup 等容錯性較強的解析庫。

默認 User-Agent:使用 Python 默認的 User-Agent 可能被網站識別為爬蟲。

請求頻率過高:頻繁發送請求可能導致 IP 不允許。

未使用會話:多次創建新的連接可能被識別為異常行為。

觸發 CAPTCHA:如果爬蟲行為被網站識別為異常,可能會遇到 CAPTCHA。可以請求頻率或更換代理 IP。

遵守網站政策:確保遵守目標網站的 `robots.txt` 文件和使用條款。

透明化身份:在請求頭部中添加聯繫信息,以便網站管理員在出現問題時聯繫妳。

通過遵循以上最佳實踐,可以有效減少抓取過程中遇到的錯誤,併提高抓取的穩定性和效率。

請通過郵件聯繫客服

我們將在24小時內通過電子郵件回复您